Contexte

Une vidéo contenant un extrait audio présenté comme un reportage de la Radio France Internationale (RFI) circule actuellement sur les réseaux sociaux, notamment sur Facebook, TikTok et WhatsApp. On y entend Corneille Nangaa, leader de l'Alliance Fleuve Congo (AFC), présenter des excuses au peuple congolais et annoncer sa volonté de se désolidariser de l'AFC/M23. Cette séquence a provoqué de vives réactions. Toutefois, après une vérification par Eleza Fact auprès de la RFI et de l'AFC/M23, il s'avère que cet enregistrement est un faux, réalisé à l'aide d'une intelligence artificielle. Selon les analyses de Hive Moderation, il s’agit d’un deepfake.

Origine et diffusion de la vidéo

D'une durée d'une minute et 56 secondes, la vidéo montre un montage alternant le logo de la RFI et des images de Corneille Nangaa ainsi que de Paul Kagame. Elle a été publiée le 2 avril dernier sur la page Facebook Le Changement c'est Fatshi qui compte actuellement plus de 64 000 abonnés et publie régulièrement du contenu lié à la politique en République Démocratique du Congo. Dans cet extrait audio, on entend Corneille Nangaa présenter des excuses et exprimer des regrets concernant son implication dans le conflit à l'est de la RDC. La légende accompagnant la vidéo indique : « Urgent : Corneille Nangaa demande pardon au peuple congolais et reconnaît sa trahison envers la nation, tout en sollicitant la grâce présidentielle auprès du président Félix Antoine Tshisekedi. »

Au 7 avril à 14h00, heure de Goma, la publication avait déjà recueilli plus de 1 300 réactions et plus de 700 partages WhatsApp. La vidéo a notamment été partagée dans le groupe Fatshi Béton News , qui compte plus de 26 000 membres, ainsi que sur TikTok et dans plusieurs groupes WhatsApp.

La RFI et l'AFC/M23 démentent cette rumeur

Contactée par Eleza Fact, Jessica Taïeb, journaliste à RFI, confirme qu'aucun reportage n'a été réalisé dans ce sens par la chaîne. « C'est faux. La chronique « Les dessous de l'infox » a consacré une édition spéciale à ce sujet ce matin sur RFI. Il s'agit d'une imitation de voix : Arthur Ponchelet (journaliste à RFI), celle de Nangaa, suivi de celle d'Aurélie Bazzara-Kibangula (correspondante de France 24 à Kinshasa). RFI n'a jamais diffusé une telle annonce » , a-t-elle précisée à Eleza Fact.

La RFI a formellement démenti l'authenticité de cette vidéo, ainsi que d'autres extraits qui lui ont été faussement attribués, dans sa chronique « Les dessous de l'infox » (archivée ici ), publiée le 4 avril dernier sur son site web. La radio précise que l'audio a été entièrement généré par une intelligence artificielle, et que les propositions attribuées à Nangaa sont totalement infondées, et appelle à la vigilance face aux contenus manipulés ou fabriqués par des outils d'IA.

Par ailleurs, Laurence Kanyuka, porte-parole et point-focal communication de l'Alliance Fleuve Congo (AFC), a également démenti la véracité de cette vidéo dans un post (archivé ici ) du 02 avril sur son compte X.

« L'Alliance Fleuve Congo (AFC/M23) informe le public que l'audio/vidéo qui circule dans les médias sociaux sous un faux logo de RFI est un faux, réalisé par le régime aux abois de Kinshasa pour occulter l'adhésion massive de nos compatriotes à l'AFC/M23 tant au niveau national que dans la diaspora », indique-t-il dans la légende du post .

Un audio généré par une Intelligence artificielle

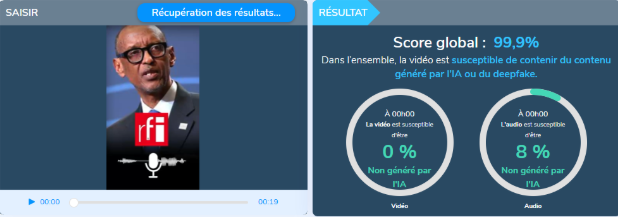

Après avoir soumis le son de la vidéo à l'outil d'analyse Hive Moderation, les résultats indiquent une probabilité de 99,9 % qu'il s'agisse d'une création générée par l'intelligence artificielle. Comme le souligne la chronique « Les dessous de l'infox » de RFI, il est manifeste que le son constitue une imitation des voix des journalistes de RFI et de France 24.

Capture des résultats de l'analyse de Hive Moderation faite par Eleza Fact

Un deepfake est une technique de manipulation numérique qui utilise des algorithmes d'intelligence artificielle pour créer des contenus audio ou vidéo trompeurs. Ces technologies permettent de superposer des visages ou de modifier des voix, rendant le faux contenu très difficile à distinguer du réel. Les deepfakes peuvent être utilisés à des fins de divertissement, mais ils comportent également des risques importants en matière de désinformation et de manipulation.

Conclusion

Eleza Fact a analysé une vidéo contenant un extrait audio présenté comme un reportage de la RFI, dans lequel Corneille Nangaa semble formuler des excuses. Après vérification, il s'avère qu'il s'agit d'un deepfake, comme l'ont confirmé plusieurs enquêtes indépendantes. Jessica Taieb, journaliste à RFI, ainsi que la rédaction de la station, ont formellement démenti l'authenticité de l'enregistrement, précisant que l'audio a été intégralement généré par une intelligence artificielle, imitant la voix de leurs journalistes. Laurence Kanyuka, porte-parole de l'AFC, a également déclaré un contenu fabriqué dans l'intention manifestée de manipuler l'opinion publique. Cet épisode illustre l'importance cruciale de vérifier l'origine des contenus et de privilégier les sources crédibles. Dans un contexte aussi sensible que celui de la RDC, la vigilance s'impose, car relayer des informations non vérifiées peut avoir des conséquences graves.