Contexte

La guerre impliquant l’Iran, Israël et les États-Unis a atteint un niveau inédit avec les frappes militaires lancées fin février 2026 et les ripostes iraniennes dans toute la région, mais ce conflit ne date pas d’hier, derrière l’escalade actuelle se cachent plusieurs décennies de rivalités géopolitiques, militaires et idéologiques.

Suite à cette situation, une vidéo est devenue virale sur les réseaux sociaux, montrant Félix Tshisekedi en train d’annoncer, au cours d’une conférence, qu’il voulait envoyer des militaires (FARDC) pour aller secourir les États Unis en ce moment de guerre.

Une analyse approfondie faite par Eleza Fact démontre que même si la séquence vidéo est tirée d’une conférence authentique, l’audio, lui, a été généré par l’intelligence artificielle. Des outils de vérification, entre autres Hive modération, InVid We Verify et Google Lens ont permis de déterminer l’authenticité de cette information.

Source de l’infox

La vidéo que nous vérifions a été mise en ligne le 08 mars 2026 par un compte TikTok de l’utilisateur MB Baudouin, qui compte près de 118 000 abonnés . Elle est accompagnée de la légende : « les FARDC devraient aller se battre pour l’Amérique ».

Les propos attribués à cette vidéo affirment : « En ce moment de guerre, nous compatissons avec nos frères israéliens victimes des attaques Iraniennes. C’est pourquoi, je voulais envoyer nos militaires pour aller secourir l’Amérique , car les Américains sont nos frères nous devons les soutenir dans le moment difficile qu’ils traversent ».

La publication a reçu plus de 460 mentions ‘’j’aime’’, 42 commentaires et 119 partages en deux jours, soit du 08 au 10 mars.

Plusieurs internautes ont commenté en niant cette allégation, affirmant qu’il s’agit d’une manipulation de l’intelligence artificielle. C’est le cas d’un internaute qui écrit : « Heureusement que c’est IA », et un autre ajoute : « Vidéo manipulée ».

Une ancienne vidéo manipulée

Pour vérifier cette information, Eleza Fact a soumis la vidéo à une recherche inversée via Google Lens. Le résultat a permis de retrouver la vidéo originale ayant servi de soubassement à ce deepfake, diffusée le 04 mai 2024, sur le site officiel de la présidence congolaise (archivé ici). Nous avons revu en intégralité les 9 minutes 53 secondes de cette production. Cette rencontre s’inscrivait dans le cadre des échanges réguliers de Tshisekedi avec les congolais de l’étranger, considérés comme un maillon essentiel du développement national, elle a visé à renforcer les liens avec la communauté congolaise de Belgique, incluant un échange sur la situation sécuritaire dans l’Est de la RDC. Nulle part, il est question d’un quelconque renforcement des nos militaires pour un prétendu secours à l’Amérique en cette période de guerre.

Par ailleurs, face à ce conflit impliquant l’Iran, Israël et les États-Unis, la RDC, en tant que membre non permanent du conseil de sécurité de l’ONU, appelle à la retenue maximale et à la désescalade diplomatique pour éviter une crise régionale. Le gouvernement congolais (archivé ici) exprime sa vive préoccupation, craint des conséquences économiques et sécuritaires, tout en cherchant à préserver son partenariat stratégique avec Washington.

Un son généré par l’intelligence artificielle

Dans cette séquence, le cadrage, le micro noir, le verre d’eau, ainsi que la disposition de la salle correspondent à la vraie vidéo. Mais au-delà de l’apparence, certains détails interpellent, son rythme et sa diction sonnent anormalement mécaniques. Cette impression de son « robotique » constitue l’un des signes les plus fréquents d’un hypertrucage audio, plus connu sous le nom de deepfake.

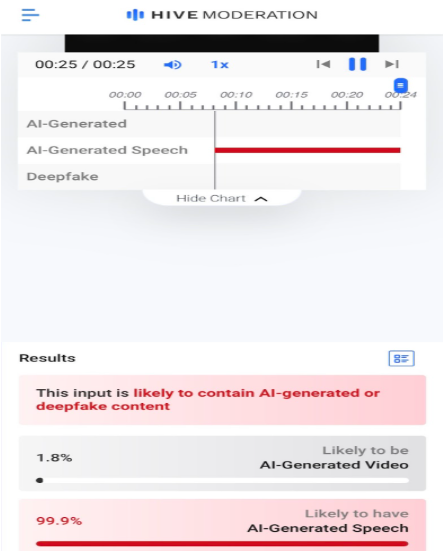

Soumise à plusieurs outils de détection, dont Hive Modération, le son de la vidéo a été identifié comme un contenu généré par intelligence artificielle avec un score de probabilité de 99,9% de génération artificielle de ce discours. Autrement dit, la voix que l’on entend n’est pas celle du chef de l’État Félix Tshisekedi, mais elle provient d’une imitation produite à l’aide de techniques d’IA.

Résultat analyse de l’outil Hive Modération, capturé par Eleza Fact

Pour confirmer cette vérification, nous avons soumis le son de la vidéo à la vérification via InVid We Verify. L’outil a donné un score de 99% de probabilité que le son soit le fruit d’une intelligence artificielle.

« Le score de la jauge représente le score de détection moyen du fichier analysé. Le graphique de gauche indique si le fichier est un composite contenant des fragments générés par l’IA. Il affiche le taux de détection par segments de 4 secondes sur toute la durée du fichier autour des parties suspectes et les réanalyser pour améliorer éventuellement la précision de la détection », indique la légende associée aux résultats d’InVid We Verify.

Résultat de la vérification effectuée par InVid We Verify capturé par Eleza Fact

Bref

Eleza Fact a pu vérifier l’authenticité d’une vidéo montrant Félix Tshisekedi, présenté comme annonçant un renforcement des militaires FARDC à l’Amérique dans le cadre de la guerre impliquant les États-Unis, Israël et l’Iran. Après analyse au moyen d’outils de vérification, dont Google Lens, Hive Moderation et Invid We Verify, Eleza Fact a confirmé que la séquence vidéo est bien authentique et remonte à mai 2024. En revanche, l’audio a été manipulé : la voix attribuée au président a été générée et modifiée grâce à des techniques d’intelligence artificielle.

Ces étapes de vérification sont importantes avant tout partage afin d’éviter de relayer, parfois de manière inconsciente, des manipulations conçues pour tromper, influencer ou polariser le débat public.