Contexte

Deux images ont été publiées sur Facebook et largement relayées, suscitant de vives inquiétudes parmi certains internautes. La première montre Félix Tshisekedi, président de la République démocratique du Congo, présenté à genoux et entouré de militaires tenant un drapeau portant l’inscription « AFC/M23 ». La seconde image montre des militaires sur le plateau d’une chaîne de télévision en train de lire un communiqué. La légende accompagnant ces images affirme qu’il s’agit d’un coup d’État perpétré par les éléments de l’AFC/M23 contre le président congolais, laissant entendre une prise de pouvoir à Kinshasa par ce mouvement politico-militaire, ce qui constitue une affirmation grave dans un contexte sécuritaire déjà sensible.

Eleza Fact a mené des vérifications approfondies en analysant ces images à l’aide de plusieurs outils spécialisés, notamment Google Lens, Hive Moderation, Is it Ai et Decopy AI. Ces analyses croisées ont permis d’établir que la première image a été générée par une intelligence artificielle, tandis que la seconde image, bien réelle, provient d’un coup d’État déjoué au Bénin et a été détournée de son contexte d’origine pour alimenter une fausse information.

Source de l’Infox

L’internaute Mwiza Kandi a publié ces images le 09 décembre dans le groupe Facebook RTNC KINSHASA, qui compte plus de 19 000 membres. La publication a rapidement attiré l’attention au sein de ce groupe, en raison de la gravité des accusations portées.

« Flash info Coût D’état en RDC… les rebelles de l’AFC M23 viennent de renverser le pouvoir de Félix Tshisekedi avec un coût d’état, la RTNC est déjà sous contrôle des rebelles et le président entre les mains des lions du sarambwe » (sans correction), annonce l’auteur dans la légende accompagnant les deux images. Ce post enregistre plus de 700 mentions « j’aime » ainsi que plus de 10 partages sur Facebook au 15 décembre, démontrant une diffusion non négligeable de cette information non vérifiée.

En commentaire, plusieurs internautes ne croient pas à l’authenticité de ces affirmations et expriment leur indignation face à cette désinformation. Certains dénoncent clairement la manipulation, tandis que d’autres ajoutent des commentaires insultants à l’égard de l’auteur. C’est le cas de cet internaute qui écrit : « Fou, que tu es. Le trio kagame, kabila et naanga vont mourir avant fashi. Fathi reste à la tête du pays jusqu' au terme de son mandat. » (sans correction orthographique), avant qu’un autre n’ajoute : « Ta maman est à la base de votre souffrance, parceque : elle a fait la dystocie à ta naissance, accouchement prolongée en plus, vous avez des séquelles neurologiques irréversible que ton âme reposé en paix » (sans correction orthographique). Ces réactions illustrent à la fois la méfiance d’une partie du public et la tension générée par ce type de désinformation.

Une image générée par l’Intelligence artificielle

En menant une analyse visuelle de la première image, plusieurs indices confirment qu’elle n’est pas authentique. Le plus évident est la présence du logo de Gemini, l’intelligence artificielle de Google, visible dans le coin inférieur droit de l’image. Cet élément suggère clairement que l’image a été générée par Gemini via Nano Banana. En outre, de nombreuses incohérences visuelles renforcent cette conclusion, notamment au niveau des lunettes de soleil de Félix Tshisekedi, de la main gauche du soldat debout à sa gauche et du drapeau de l’AFC/M23, qui ne correspond pas au drapeau officiel connu de ce mouvement.

Logo de Gemini visible sur l’image, zoom effectué par Eleza Fact

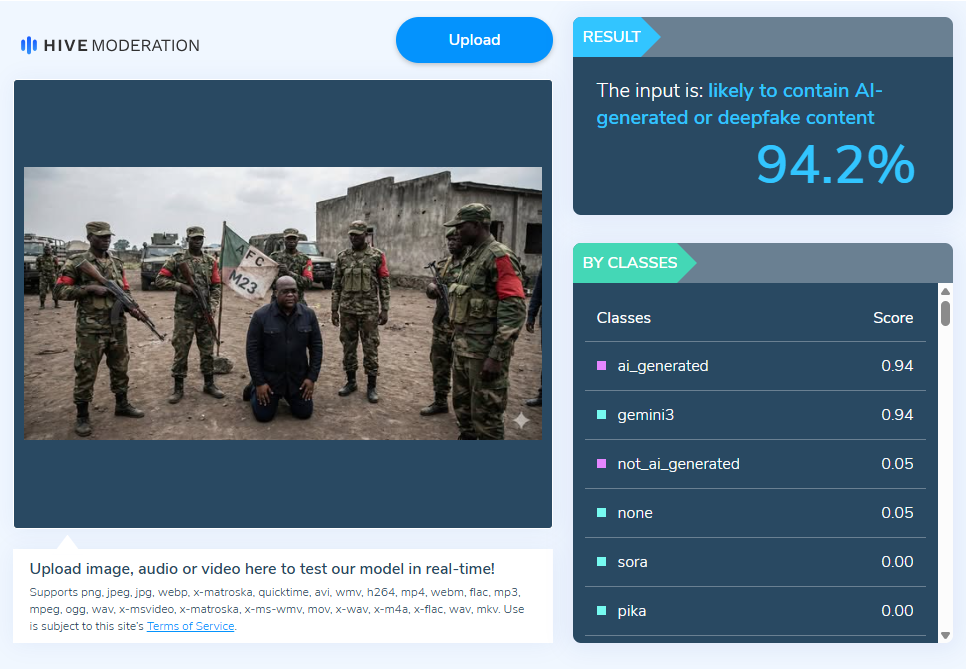

En analysant l’image avec Hive Moderation, l’outil indique une probabilité de 94,2 % que l’image soit générée par l’intelligence artificielle, ce qui constitue un indice technique fort de manipulation numérique.

Résultats des analyses de Hive Moderation capturés par Eleza Fact.

Résultats des analyses de Hive Moderation capturés par Eleza Fact.

L’outil Decopy AI vient confirmer ces analyses en indiquant, à son tour, 96 % de probabilité que l’image a été créée par l’intelligence artificielle. L’outil fournit également des détails précis sur plusieurs parties de l’image présentant des incohérences visuelles, dont :

« Les motifs de camouflage des uniformes des soldats sont réguliers et nets, mais les textures paraissent légèrement plates et manquent de détails de tissu complexes typiques d'une photographie réaliste. Les armes et l'équipement sont uniformes en couleur et en brillance, sans imperfections mineures ni reflets dus à différents angles d'éclairage ;

La peau de l'homme agenouillé paraît uniformément lisse, sans les variations cutanées habituelles ni les pores apparents. Son expression faciale est dépourvue des subtiles tensions musculaires et des micro-expressions propres aux émotions humaines authentiques. Les visages des soldats présentent le même schéma, avec des traits soit légèrement flous, soit excessivement lissés ;

Les couleurs et le texte du drapeau sont nets et uniformes. Le tissu du drapeau ne présente pas les plis et froissements naturels qui apparaissent généralement en extérieur. Le mur et les véhicules en arrière-plan semblent un peu trop propres et uniformes en termes de texture, manquant de la profondeur et des variations propres aux environnements naturels et l'éclairage des personnes et des objets est uniforme, mais légèrement artificiel, avec des ombres qui manquent de dégradé et de profondeur. La scène d'ensemble paraît un peu terne en termes de contraste et de saturation, ce qui atténue les effets de lumière dynamiques propres à une photographie réelle ».

Résultats des analyses de Decopy AI capturés par Eleza Fact.

Résultats des analyses de Decopy AI capturés par Eleza Fact.

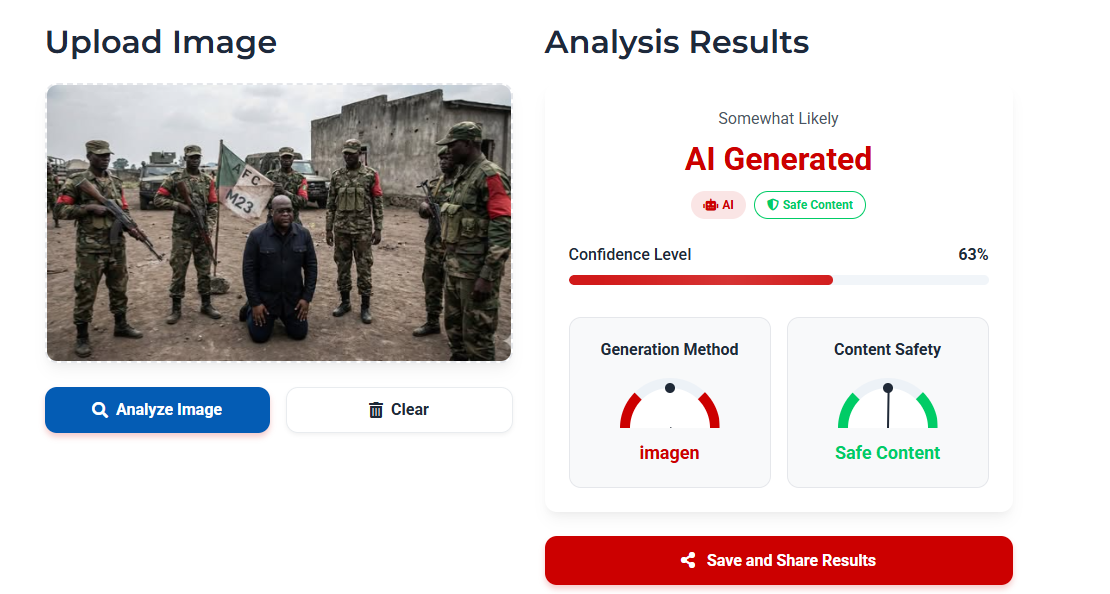

Enfin, Is It Ai confirme à son tour ces conclusions en indiquant une probabilité de 63 % que l’image soit générée par l’intelligence artificielle, renforçant ainsi l’ensemble des constats techniques.

Résultats des analyses d’Is It Ai capturés par Eleza Fact.

Résultats des analyses d’Is It Ai capturés par Eleza Fact.

Une image d’un coup d’État raté au Bénin

En lançant une recherche inversée via Google Lens, Eleza Fact a identifié plusieurs correspondances prouvant que la seconde image n’a aucun lien avec la RDC. Elle a été prise lors de l’annonce d’un coup d’État au Bénin.

L’image est visible dans un article publié le 07 décembre dernier par Courrier international (archivé ici). Cet article confirme qu’il s’agit d’une capture d’écran montrant des soldats du CMR annonçant à la télévision béninoise la dissolution du gouvernement du président Patrice Talon.

Le même jour, la BBC a également rapporté (archivé ici) que l’image montrait un groupe de soldats apparu à la télévision nationale au Bénin, affirmant avoir renversé le président Patrice Talon. Ces militaires annonçaient alors la suspension de la Constitution ainsi que la fermeture des frontières terrestres et de l’espace aérien du pays.

De son côté, Radio France Internationale (archivé ici) a indiqué que l’image montre des militaires ayant annoncé, le dimanche 07 décembre, à la télévision publique béninoise, la destitution du président Patrice Talon. Ces soldats affirmaient que le lieutenant-colonel Tigri Pascal avait été nommé président d’un « Comité de la refondation militaire ».

Ces mêmes informations ont été reprises par RTBF, Jeune Afrique, Le Monde Fr, Ouest-France et TV5 Monde, confirmant unanimement l’origine béninoise de l’image et établissant qu’elle n’a aucun lien avec un quelconque coup d’État en République démocratique du Congo (documentées ici, ici, ici, ici et ici).

Aucun coup d’État signalé à Kinshasa en décembre 2025

En décembre 2025, aucune tentative de coup d'État n'a été signalée à Kinshasa ni ailleurs en RDC. La seule actualité récente majeure liée à ce type d’événement reste la tentative de coup d'État du 19 mai 2024, dont les suites judiciaires ont continué à être traitées tout au long de l’année 2025.

Il convient également de préciser que Félix Tshisekedi demeure bel et bien en fonction en tant que président de la République démocratique du Congo. Il a d’ailleurs présidé la 71ᵉ réunion ordinaire du Conseil des ministres le vendredi 19 décembre à la Cité de l’Union africaine, à Kinshasa, soit dix jours après la diffusion de la fausse annonce de coup d’État sur Facebook.

Verdict

La publication affirmant qu’un coup d’État a eu lieu à Kinshasa est fausse. Les vérifications menées par Eleza Fact, démontrent que l’une des images a été entièrement générée par une intelligence artificielle, tandis que l’autre provient d’un événement sans lien avec la RDC, à savoir un coup d’État avorté au Bénin, et a été utilisée hors contexte. Aucun élément crédible ni aucune source officielle ne confirment une tentative de prise de pouvoir en République démocratique du Congo en décembre 2025.

Dans un contexte sécuritaire tendu, ces genres de contenus peuvent être à la base de tensions au sein des populations. Il est important de se fier aux sources crédibles avant de partager ou croire à une affirmation sur les réseaux sociaux.